TL;DR

- Гемони приближается к API Google Homes.

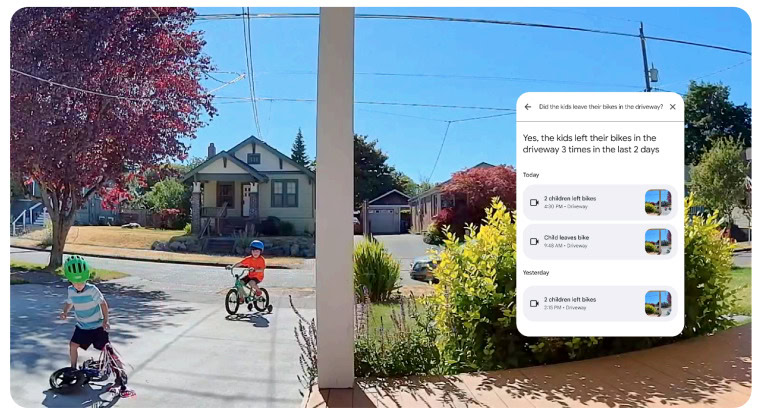

- Пользователи смогут задавать вопросы на естественном языке о своей истории использования камеры и получать описания, сгенерированные искусственным интеллектом.

- Google облегчает создание автоматизированных систем, которые подходят для устройств в вашем доме.

- Компания тестирует виджет домашней сводки для устройств Pixel.

На мероприятии Google I/O 2021 было представлено множество новых технологий с акцентом на ИИ, включая Veo 3, живое разделение экрана через Gemini Live, улучшенный режим ИИ для Google Поиска и многое другое. И если вы подумали, что это все после потока обновлений, у Google есть еще больше анонсов связанных с искусственным интеллектом, которые они хотят поделиться. Новые разработки касаются интеграции Gemini в API Google Home.

"Просто покупай индекс", говорили они. "Это надежно". Здесь мы обсуждаем, почему это не всегда так, и как жить с вечно красным портфелем.

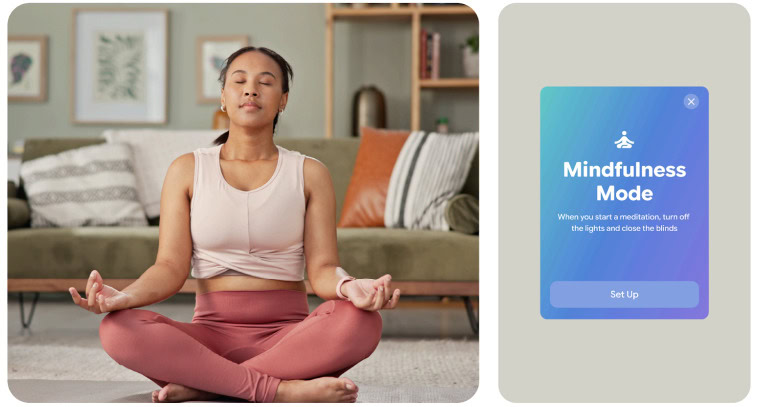

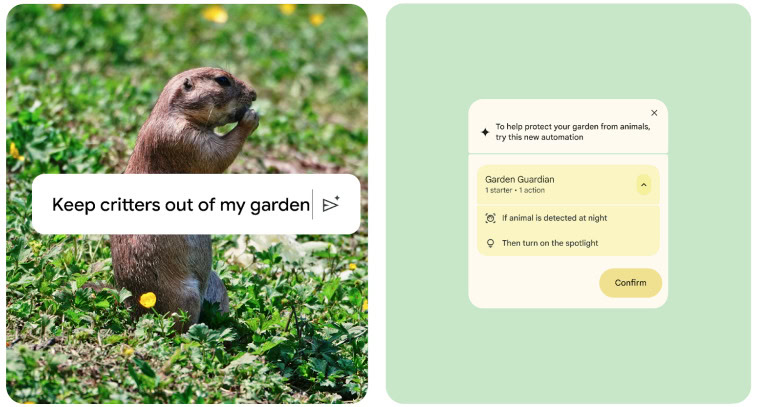

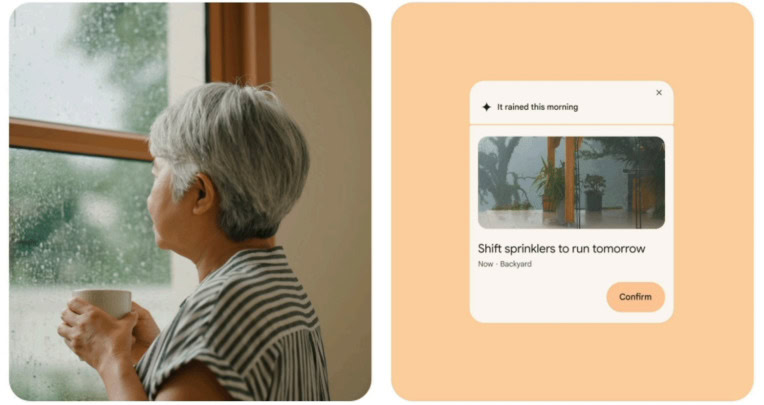

Поверить в рынокЯ только что заметил, что Google активно развивает свои проекты в сфере умного дома, интегрируя Gemini. Одним из инновационных способов использования своей технологии искусственного интеллекта является оптимизация автоматизации для более удобного взаимодействия с умным домом. Например, если вам сложно придумать идеи автоматизации для вашего дома, Gemini теперь проанализирует ваши устройства и предложит подходящие варианты. Если создание автоматизации кажется слишком сложной задачей, вы можете просто сформулировать свои цели AI-системе, которая затем составит за вас автоматизацию. Кроме того, появились новые стартовые точки для создания автоматизации, предоставляющие продвинутые условия срабатывания на основе дат и погодных условий, что позволяет вашим автоматизациям реагировать более адаптивно.

Двигаясь вперёд, Google предоставляет разработчикам несколько продвинутых функций камеры под названием Gemini. Помимо прямого трансляций, доступа к истории событий, двусторонней связи и регулируемых настроек камеры, пользователи теперь получат преимущества в виде AI-сгенерированных описаний и возможности поиска своей истории камеры с помощью Gemini. Это должно упростить процесс эффективного нахождения нужных видео.

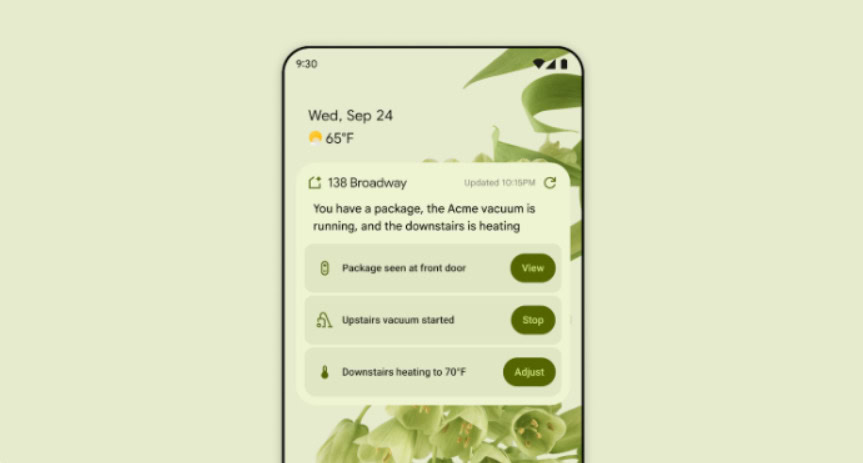

В ноябре 2024 года я наткнулся на интересные новости как техноэнтузиаст: Google разрабатывает домашний сводный виджет исключительно для устройств Pixel! Если вы когда-либо мечтали легко контролировать свой умный дом, этот виджет может сделать эту мечту реальностью. Вместо того чтобы открывать приложение для проверки состояния дел, вы сможете просматривать информацию о вашем доме прямо с главного экрана устройства. Правда, похоже, нам придется немного подождать — компания все еще находится на этапе тестирования среди избранных пользователей, поэтому эта функция пока не доступна для всех нас. Но хорошие вещи приходят к тем, кто умеет ждать, верно?

Google также раскрыл несколько дополнительных новостей: они разработали новые партнерские функции с использованием API для устройств Home, такие как First Alert, Yale, iRobot, Cync, Motorola Moto Tag и Tuya Smart. Кроме того, планируется запустить программу раннего доступа к Gemini-powered API для Home в конце этого года, а также организовать серию конкурсов для разработчиков, чтобы помочь им развивать свои навыки.

На конференции Google IO они поделились множеством информации. Для тех, кто её пропустил, вы можете ознакомиться со всеми подробностями в нашей полной статье, охватывающей всё мероприятие.

Смотрите также

- 30 лучших фильмов об обмене парой и женой, которые вам нужно посмотреть

- YouTube дает сбой — что делать, если в вашей ленте застрял NaN:NaN

- Объяснение всех функций искусственного интеллекта в Gmail

- 10 лучших чехлов, которые обязательно нужно иметь для вашего нового Samsung Galaxy S25 Ultra!

- Google Pixel 10 Pro Fold против Honor Magic V5: Битва флагманов

- Обновление быстрой зарядки до 23 Вт в Google Pixel 9a делает два шага вперед и один шаг назад.

- OnePlus усложняет потерю OnePlus 13 благодаря редкой функции «Найти мое устройство».

- 25 Проверки навыков в играх, которые всё меняют

- 15 актеров, идеально подходящих на роль Хьюго Стрэнджа во вселенной DC

- 5 вещей, которые Android стоит позаимствовать у iPhone 17 от Apple

2025-05-22 19:17