- Некоторые сообщения пользователей привлекают внимание после того, как несколько человек столкнулись с мошенничеством, последовавшим за телефонными номерами, возвращенными обзорами искусственного интеллекта от Google.

- Пользователи, ищущие номера службы поддержки клиентов, попадали в мошеннические схемы, едва не потеряв свои деньги и не столкнувшись с другими неприятностями.

- Еще один отчет утверждает, что Google «знает» о проблеме, но пользователям все равно следует проявлять крайнюю осторожность в будущем.

Как любитель технологий, я не могу не выразить свою обеспокоенность по поводу обзоров на основе искусственного интеллекта от Google, которые, кажется, в последнее время попали в затруднительное положение. Пользователи, включая меня, обнаружили, что невольно становятся жертвами мошенничества из-за номеров телефонов, предоставленных системой. Я надеюсь, что Google оперативно решит эту проблему и обеспечит, чтобы их сервисы на основе искусственного интеллекта предоставляли надежную и безопасную информацию в будущем.

"Просто покупай индекс", говорили они. "Это надежно". Здесь мы обсуждаем, почему это не всегда так, и как жить с вечно красным портфелем.

Поверить в рынокСогласно Digital Trends, как сообщает Android Authority, была представлена серия жалоб пользователей. Все утверждают, что они были обмануты, используя номера телефонов, предоставленные обзорами ИИ от Google. Пользователь Reddit поделился экземпляром, когда их друг стал жертвой мошенничества, связанного с пропавшим приказом Swiggy Instamart за границей. Друг искал номер обслуживания клиентов Swiggy, но вместо этого получил номер телефона, который привел к аферу.

Во время звонка выяснилось, что ситуация необычная, так как человек, представившийся сотрудником службы поддержки, неожиданно попросил пользователя «поделиться экраном» и одобрил «UPI-транзакцию» (денежный перевод). После завершения звонка стало очевидно, что что-то не так. Кроме того, пользователь обнаружил, что Swiggy Instamart не предоставляет телефонную поддержку — только помощь через чат.

⚠️ ВНИМАНИЕ: МОШЕННИЧЕСТВО – Поддельные номера службы поддержки клиентов! из r/Bengaluru

Аналогичным образом, Digital Trends последовал за другим отчетом Алекса Ривлина о Facebook. В своем поиске Ривлин искала «телефонный номер круглосуточной поддержки клиентов Royal Caribbean в США». Она поделилась этим путешествием в восьмиминутном видео. Как подробно описано в кратком посте, Ривлин пыталась найти информацию для бронирования шаттла для предстоящего круиза. Номер, предоставленный ИИ Quick Facts от Google, однако, оказался мошенническим, напрямую ведущим к аферисту.

В своем посте Ривлин объясняет, как мошенники безупречно имитировали каждую деталь — цены, терминологию и даже особенности транспортировки. Им удалось убедить его раскрыть информацию о своей кредитной карте, но он вовремя заметил обман. Он также отмечает, что благодаря результатам, сгенерированным искусственным интеллектом, и поддельным деталям, схема стала намного сложнее.

1) Пользователи выражают недовольство из-за появления мошеннического номера в верхней части результатов поиска Google вместо Royal Caribbean, как некоторые отметили в комментариях в Facebook. Android Authority сообщает, что Google признал эту проблему и предпринимает шаги по улучшению результатов поиска, согласно заявлению представителя, цитируемого в Washington Post. В статье также говорится, что Google предпринял действия против нескольких подозрительных номеров, которые они выявили.

Компания обратилась в Google по поводу подозрительных телефонных номеров, появляющихся в их AI-сводках. Мы обязательно обновим эту запись, как только получим ответ.

Искусственный интеллект ошибается

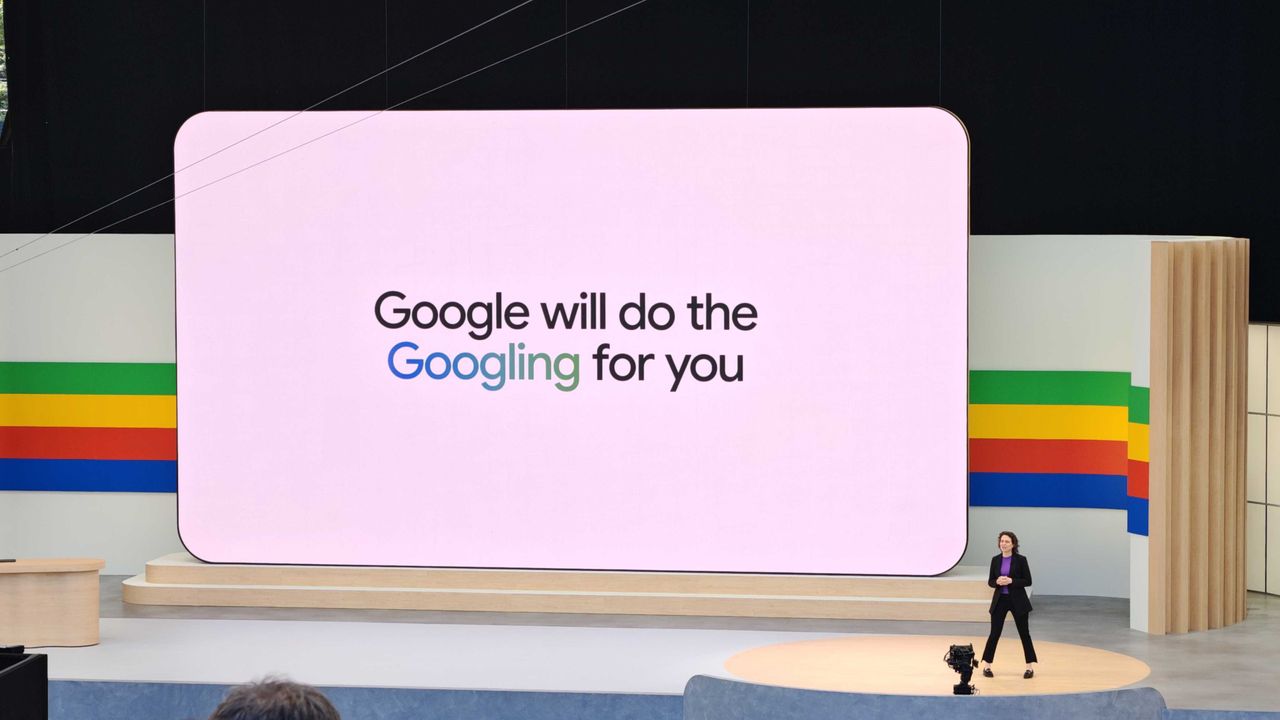

Растущее внедрение искусственного интеллекта, особенно в поисковых системах, обычно направлено на упрощение процесса поиска тем и информации для пользователей. Однако, как показала история, ИИ не безошибочен и иногда может допускать ошибки. Например, мы помним инцидент в 2024 году, когда главе отдела поиска Google Лиз Рейд пришлось отреагировать на ошибочные результаты обзора ИИ, которые, казалось, восприняли сатиру слишком буквально. Как объяснила Рейд, эти ошибки часто возникают из-за недостатка достаточной информации по теме, заставляя ИИ обращаться к нерелевантным или вымышленным деталям.

Как аналитик данных, я заметил, что наша модель искусственного интеллекта, возможно, непреднамеренно отдавала предпочтение контенту, созданному пользователями, а не ресурсам из авторитетных и надёжных источников, которые часто предоставляют более прочную основу для проверяемой информации.

В ходе изучения текущих данных о мошенничестве, кажется, мы имеем дело не с «недостатком информации», а скорее с ситуацией, когда ИИ от Google в основном извлекает информацию, не проверяя ее самостоятельно. Как исследователям, по-прежнему важно подтверждать любые результаты, полученные от этих ботов. Важно отметить, что обзоры и другие ресурсы, предоставляемые системами ИИ, часто включают обратные ссылки для дальнейшего чтения. При поиске критически важных деталей всегда помните об отслеживании этих ссылок.

Еще одним важным фактором, усугубляющим проблему, является чрезмерная публикация несерьезного контента, или, проще говоря, длительная череда размещения непродуктивных сообщений.

Смотрите также

- Объяснение всех функций искусственного интеллекта в Gmail

- YouTube дает сбой — что делать, если в вашей ленте застрял NaN:NaN

- 10 лучших чехлов, которые обязательно нужно иметь для вашего нового Samsung Galaxy S25 Ultra!

- Samsung Galaxy Z Flip 7 протестирован: Exynos 2500 ещё предстоит многое улучшить.

- Первые 11 вещей, которые нужно сделать с Samsung Galaxy Watch Ultra

- Как работает международный роуминг Mint Mobile и стоит ли оно того?

- Предстоящие флагманские Android-устройства могут получить смелый новый внешний вид, и, вероятно, за это стоит благодарить Apple.

- Какое подземелье Destiny 2 проще всего пройти в одиночку?

- Этот новый портативный компьютер предлагает сменные джойстики, крестовины и тачпады в стиле Steam Deck.

- Мой опыт с очками дополненной реальности нового поколения превратил меня из скептика в верующего.

2025-08-18 22:24