TLDR

- Google удалила свою модель Gemma из AI Studio после того, как она сгенерировала ложное утверждение о сенаторе Марше Блэкберн.

- Блэкберн выпустил официальное письмо, обвиняющее модель в клевете; Google заявляет, что Gemma не предназначалась для фактического потребительского использования.

- Gemma остаётся доступной через API для разработчиков, в то время как инцидент поднимает более важные вопросы об ответственности и мерах предосторожности в общедоступных инструментах искусственного интеллекта.

Google недавно запустила Gemma, мощную языковую модель искусственного интеллекта в рамках своего AI Studio. Она предназначена для помощи разработчикам в создании таких вещей, как текст, планы и резюме. Этот релиз был частью усилий Google по поощрению открытого изучения своей AI-технологии, но всё пошло не по плану.

"Просто покупай индекс", говорили они. "Это надежно". Здесь мы обсуждаем, почему это не всегда так, и как жить с вечно красным портфелем.

Поверить в рынокGoogle удалил Gemma, свою AI-модель, из публичного доступа. Это изменение произошло после того, как сенатор Марша Блэкберн (республиканка, Теннесси) отправила письмо генеральному директору Google Сундару Пичаи. Блэкберн сообщила, что когда её спросили об обвинениях в её адрес, Gemma ложно утверждала, что её обвиняли в изнасиловании, как впервые отметила TechCrunch.

В письме, которое я рассмотрел, Gemma утверждает, что в 1987 году, во время предвыборной кампании в сенат штата, сотрудник дорожной полиции обвинил Блэкберн в том, что она попросила его достать для неё рецептурные лекарства. В письме также утверждается, что эти отношения включали действия, которые не были добровольными.

Blackburn решительно отверг утверждения, написав:

Ничего из этого не соответствует действительности, даже год кампании, который на самом деле был 1998 годом. Ссылки ведут на страницы ошибок и несвязанные новостные статьи. Никогда не было такого обвинения, нет такого человека и нет таких новостей. Это не безобидная «галлюцинация». Это акт клеветы, созданный и распространенный AI-моделью, принадлежащей Google.

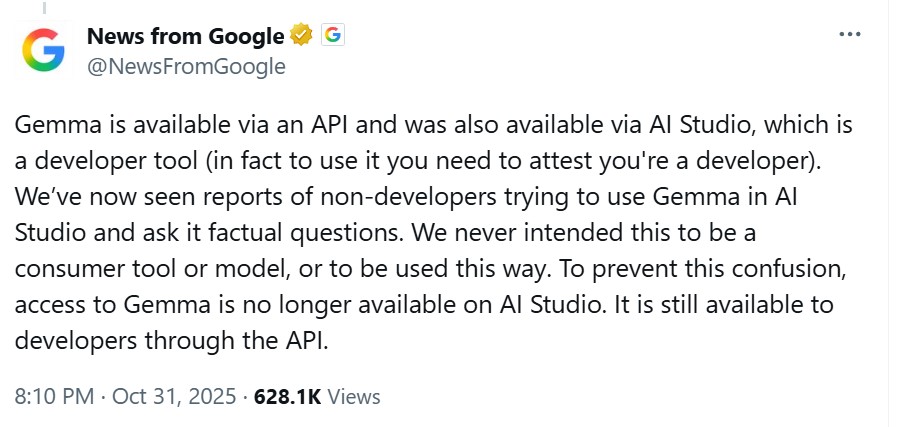

Google не ответил напрямую на полученное письмо, но опубликовал сообщение в X о сообщениях о людях без опыта программирования, пытающихся использовать его модель ИИ Gemma для получения ответов на вопросы. Google объяснил, что Gemma не была разработана для использования широкой публикой в качестве инструмента для поиска фактов, а также признал, что большие языковые модели, такие как Gemma, иногда могут предоставлять неверную или вводящую в заблуждение информацию.

Я узнал, что, хотя модель больше не доступна через интерфейс Studio, Google подтвердил, что она по-прежнему доступна для разработчиков и исследователей, таких как я, через API.

Откладывая в сторону юридические осложнения, это дело выявляет три основные проблемы с ИИ сегодня: определение того, кто несет ответственность, когда что-то идет не так, обеспечение доступа к этим технологиям для всех и сложность разграничения между простой ошибкой и вредоносными, ложными утверждениями. Даже если ИИ не намерен нанести ущерб репутации кого-либо, ложная информация, которую он создает о конкретном человеке, все равно может причинить реальный вред. Некоторые юристы из Cliffe Dekker Hofmeyr полагают, что существующие законы о клевете могут скоро быть применены непосредственно к контенту, созданному ИИ.

Как поклонник этих AI-моделей, я испытываю смешанные чувства. Кажется, Google сейчас проявляет особую осторожность. Они осознают, что если эти модели дают неверные ответы, это действительно может навредить людям, поэтому они ограничивают круг пользователей, которые могут использовать их напрямую через веб-сайты. Хорошая новость заключается в том, что разработчики, такие как я, все еще могут экспериментировать с мощными версиями через API. Но для обычных пользователей, похоже, нам придется подождать, пока Google не будет более уверена, что AI не будет совершать ошибок. Это не *полностью* решает проблему «галлюцинаций» AI или выдумывания фактов, но это означает, что сейчас меньше людей увидят эти ошибки.

В конечном итоге, даже инструменты искусственного интеллекта, разработанные для технических пользователей, могут иметь реальные последствия для всех. Поскольку правительства начинают обращать внимание, таким компаниям, как Google, возможно, придется быстрее, чем ожидалось, ограничить общественный доступ к этим AI-системам.

Смотрите также

- Как работает международный роуминг Mint Mobile и стоит ли оно того?

- YouTube дает сбой — что делать, если в вашей ленте застрял NaN:NaN

- Сэм Витвер подтверждает хронологию Маула: Лорда Тени и дразнит новый темный сериал по Звездным Войнам.

- 10 лучших чехлов, которые обязательно нужно иметь для вашего нового Samsung Galaxy S25 Ultra!

- Джессика Альба, 44, привлекает внимание на романтической прогулке с Дэнни Рамиресом.

- Сбои в работе будильника Pixel 9: Вы в числе разочарованных пользователей?

- Объяснение всех функций искусственного интеллекта в Gmail

- Самые мускулистые актеры Голливуда, ранжированные

- Предстоящие флагманские Android-устройства могут получить смелый новый внешний вид, и, вероятно, за это стоит благодарить Apple.

- Практика: обзор Focal Hadenys

2025-11-03 21:18