Как опытный исследователь с многолетним опытом работы в области искусственного интеллекта, я воочию стал свидетелем того, насколько ценными могут быть данные, генерируемые пользователями, для улучшения моделей ИИ. Однако я также глубоко обеспокоен возможным неправомерным использованием конфиденциальной информации, особенно когда речь идет о корпоративных секретах или личных разговорах.

"Просто покупай индекс", говорили они. "Это надежно". Здесь мы обсуждаем, почему это не всегда так, и как жить с вечно красным портфелем.

Поверить в рынок1. Общеизвестно, что чат-боты, такие как ChatGPT, автоматически сохраняют каждое ваше взаимодействие с ними. Эти данные необходимы для уточнения и улучшения лежащих в их основе языковых моделей. Фактически, Google, как сообщается, заплатил 60 миллионов долларов за высококачественный контент с Reddit. Следовательно, важно отметить, что ваши обсуждения могут быть приоритетными для обучения модели. Однако если вы используете ChatGPT, Gemini или аналогичные инструменты искусственного интеллекта на работе и делитесь конфиденциальными данными компании или коммерческой тайной, это может создать проблему из-за потенциального использования таких разговоров при обучении моделей.

К счастью, для тех, кто предпочитает использовать современных чат-ботов, сохраняя при этом свою конфиденциальность, есть хорошая новость: большинство этих платформ предоставляют возможность отказаться от обучения моделям ИИ. Вот как вы можете это сделать:

Как отключить обучение модели ИИ в ChatGPT

Один из простых способов предотвратить использование вашего взаимодействия с ChatGPT для разработки будущих моделей ИИ заключается в следующем: убедитесь, что вы не делитесь конфиденциальной информацией во время чатов. Это означает, что следует избегать обсуждений конфиденциальных тем, личных данных или любых материалов, защищенных правами интеллектуальной собственности. Поступая так, вы ограничиваете объем потенциально полезных данных, которые можно извлечь в целях обучения.

- Перейдите в ChatGPT и зарегистрируйтесь или войдите в свою учетную запись OpenAI.

- Если вы используете компьютер, нажмите значок своего профиля в правом верхнем углу и откройте меню Настройки. Вы найдете это в меню гамбургера в телефонном приложении ChatGPT.

- В настройках выберите Управление данными > Улучшить модель для всех и отключите этот переключатель.

На протяжении многих лет я взаимодействовал с различными моделями искусственного интеллекта и хочу поделиться некоторыми мыслями об изменении настроек в функциях чат-бота. Позвольте мне уточнить, что любые внесенные вами изменения будут влиять только на наше будущее взаимодействие. К сожалению, это не повлияет на старые чаты. Даже если вы решите удалить предыдущие разговоры, они, скорее всего, будут заархивированы на серверах OpenAI.

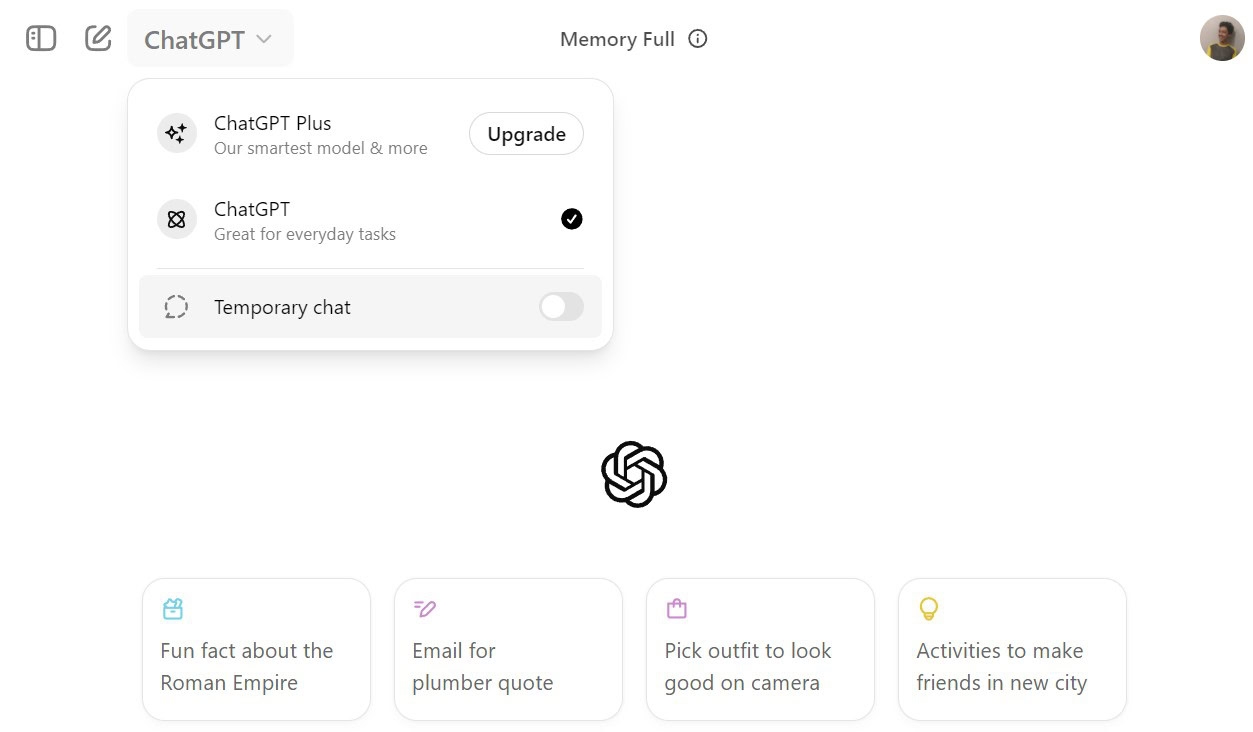

Как наблюдатель, я бы предложил следующее: если вы предпочитаете остановить обучение модели ИИ для определенных взаимодействий, у вас есть возможность использовать функцию временного чата ChatGPT. В этом случае разговор не будет сохранен в вашей истории чата и не будет способствовать обучению модели. Это относится ко всем временным чатам, независимо от настройки «Улучшить модель для всех» в вашей учетной записи.

Чтобы начать новый разговор с ChatGPT, выполните следующие действия:

Как отказаться от обучения модели ИИ в Google Gemini

1. Чат-бот Google Gemini широко известен благодаря своей широкой доступности практически на каждом смартфоне Android. В отличие от своего предшественника, Google Assistant, который также вел журналы разговоров для возможного обучения, не ожидалось, что ИИ дойдет до такой степени, что такая история станет значимой. Как заявляет Google, минимальный процент ответов чат-бота проверяется операторами вручную.

Вот как можно отказаться от использования взаимодействия с вашим чат-ботом Gemini для обучения:

- Если вы используете Gemini через веб-браузер, нажмите кнопку «Активность». Вы должны перейти на страницу под названием «Ваша активность в приложениях Gemini».

- Разверните раскрывающееся меню рядом с текстом «Активность приложений Gemini» и выберите «Отключить».

- Вы также можете выбрать «Отключить и удалить активность», чтобы стереть всю историю чата с Gemini. По умолчанию Google автоматически удаляет чаты старше 18 месяцев.

1. Это изменение будет распространяться на все новые разговоры, которые будут развиваться в дальнейшем. Существующие чаты, отправленные на проверку, могут оставаться на серверах Google в течение трех лет. Однако в случае отказа компания будет хранить ваши будущие обсуждения только в течение 72 часов.

Прекращение обучения модели ИИ в Gemini означает утрату выгодной функции расширений, которая интегрирует чат-бота с такими сервисами Google, как Gmail, Docs, YouTube и другими. Как я подчеркивал в своем посте об этическом использовании Gemini на работе, многие наиболее эффективные функции чат-бота зависят именно от этой интеграции.

Как отказаться от обучения модели ИИ на X (ранее Twitter)

Как аналитик, я обнаружил интересный факт: ранее известная как Twitter, платформа теперь предлагает чат-бота с искусственным интеллектом по имени Грок. Этот бот доступен исключительно через подписку Premium, а это означает, что обычные пользователи могут не получить возможности взаимодействовать с ним, если они не обновят свою учетную запись. Интересно, что компания использовала свою обширную коллекцию твитов для обучения Грока, хотя большинство пользователей никогда напрямую не взаимодействуют с этой расширенной функцией.

Как технический энтузиаст, я рад сообщить, что у вас есть возможность контролировать использование ваших данных! Просто выполните следующие действия: откройте Настройки, затем Конфиденциальность и безопасность и, наконец, Grok. Оказавшись там, просто отключите переключатель с надписью «Разрешить использование ваших сообщений, взаимодействий, входных данных и результатов с Grok для обучения и тонкой настройки». Таким образом, вы можете быть уверены, что ваши данные не будут способствовать формированию будущих моделей.

Можете ли вы отключить обучение модели ИИ на Клоде?

Языковые модели Claude, разработанные Anthropic, привлекли значительное внимание и в последнее время стали сильным конкурентом популярным моделям GPT. Что отличает Claude от конкурентов, так это уникальный подход к тренировкам. В отличие от других компаний в этой области, Anthropic не включает взаимодействие с пользователем в стандартный процесс обучения модели. Согласно их странице поддержки, разговоры с Клодом используются для улучшения модели только при определенных обстоятельствах: когда они подвергаются оценкам доверия и безопасности, о которых явно сообщают пользователи, или если пользователи дали явное согласие на использование своих данных в этом образом.

Как поклонник технологий, я могу вам сказать, что в обычных ситуациях мои разговоры с Клодом остаются конфиденциальными. Более того, когда вы решите удалить определенные чаты через приложение или веб-сайт, Anthropic уверяет нас, что они будут хранить их всего тридцать дней, прежде чем удалить их навсегда.

Как отключить обучение модели ИИ в Meta AI и Microsoft Copilot

К сожалению, чат-бот Microsoft Copilot не предоставляет пользователям возможности отказаться от использования их разговоров для обучения моделей. Хотя Microsoft использует OpenAI GPT-40 в качестве основы, остается неясным, способствует ли взаимодействие с пользователем улучшению моделей искусственного интеллекта, специфичных для Microsoft.

Далее, Meta AI использует десятилетия пользовательских материалов из Facebook, Instagram и других платформ, принадлежащих Facebook, для своих достижений.

1. Чтобы предотвратить обучение модели ИИ с использованием ваших данных в Facebook и Instagram, особенно если вы проживаете в Европейском Союзе или Великобритании, вы можете заявить о своем праве на возражение. Вот как:

1. Принятие этих рекомендаций позволит вам лучше контролировать, как платформы разговоров с искусственным интеллектом используют ваше взаимодействие. Однако важно отметить, что, хотя такие настройки обеспечивают определенный уровень конфиденциальности, нет никакой гарантии, что компании всегда будут соблюдать заявленную политику. Чтобы обеспечить максимальную безопасность и конфиденциальность, я предлагаю использовать на вашем персональном компьютере автономного чат-бота, такого как Meta’s Llama 3. Таким образом, все разговоры остаются внутри вашего устройства, исключая возможность передачи данных куда-либо еще.

Смотрите также

- Обзор Fiio K19: лучшее обновление ЦАП

- YouTube дает сбой — что делать, если в вашей ленте застрял NaN:NaN

- Поддерживает ли Samsung Galaxy S24 FE eSIM и две SIM-карты?

- 30 лучших фильмов об обмене парой и женой, которые вам нужно посмотреть

- Sonus Faber Lumina II Аматор

- 15 Португальских Фильмов, Которые Ошеломят Вас

- Я попробовал Oxygen OS 15, и вот что у OnePlus получилось правильно (а что нет)

- 10 лучших чехлов, которые обязательно нужно иметь для вашего нового Samsung Galaxy S25 Ultra!

- Обзор OnePlus Nord 4: просто великолепно

- Two Point Museum — еще одна порция очаровательного симулятора с капелькой приключений.

2024-07-30 04:18