TLDR

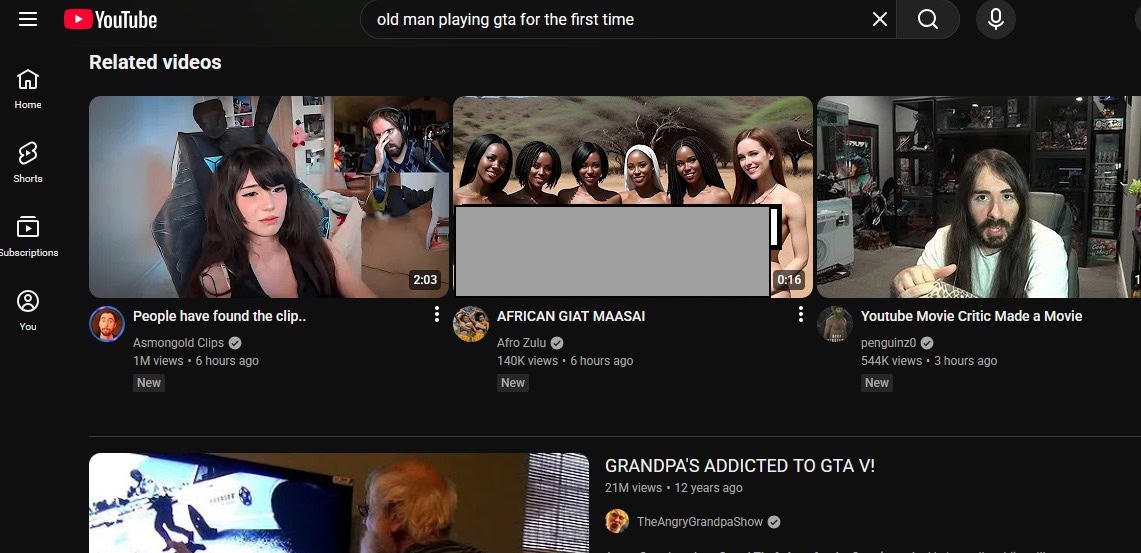

- Рекомендательный алгоритм YouTube ненадолго продвигал видео с NSFW-миниатюрой, сгенерированной ИИ, широкому кругу пользователей, включая несовершеннолетних и тех, кто искал не связанный контент.

- Видео под названием «AFRICAN GIAT MAASAI» достигло 3,9 миллиона просмотров, несмотря на то, что фактический 16-секундный ролик не содержит откровенного контента.

- Канал с тех пор обновил миниатюру до SFW-версии, но инцидент вызывает опасения по поводу контента, сгенерированного ИИ, и алгоритма рекомендаций.

Окей, так YouTube в последнее время подвергается большому количеству критики из-за своего недавнего редизайна, и, честно говоря, я понимаю – это большое изменение! Но есть кое-что *действительно* тревожное, что также происходит. Оказывается, YouTube ненадолго рекомендовал видео с, скажем так, *не предназначенными для работы* миниатюрами – и они были сгенерированы ИИ! Самое ужасное? Люди видели эти рекомендации, даже когда искали совершенно не связанные вещи, и это происходило не только со взрослыми – это затрагивало пользователей всех возрастов. Это довольно серьезный недосмотр и вызывает серьезные вопросы об их рекомендательных алгоритмах.

"Просто покупай индекс", говорили они. "Это надежно". Здесь мы обсуждаем, почему это не всегда так, и как жить с вечно красным портфелем.

Поверить в рынокМногие пользователи сообщают о том, что им неоднократно рекомендуют тревожное видео на YouTube. Видео под названием «AFRICAN GIAT MAASAI» содержит изображение, сгенерированное искусственным интеллектом, на котором изображены обнажённые женщины. Многочисленные пользователи отметили этот контент, и проблема носит массовый характер.

Пользователи жалуются на превью видео, многие считают его неподобающим для общей рекомендации. Интересно, что само 16-секундное видео не содержит откровенного контента. Этот канал, Afro Zulu, имеет тенденцию использовать вызывающие или откровенные превью, даже если сами видео чистые.

Окей, это действительно странно. Я заметил, что одно и то же видео появляется *везде* на YouTube, и не только в релевантных поисках – я вижу его после поиска совершенно несвязанных вещей! Кажется, алгоритм дал сбой, или кто-то действительно взломал код, чтобы продвинуть свое видео. Что еще более тревожно, люди говорят, что оно рекомендуется всем типам зрителей, даже маленьким детям, что, безусловно, вызывает некоторые вопросы.

Изображение для превью видео было изменено на версию, безопасную для просмотра. Тем не менее, его уже посмотрели почти 4 миллиона человек. Я проверил поисковые запросы, которые люди использовали для его поиска, и теперь оно больше не появляется в этих несвязанных результатах. Если вы сейчас поищете по названию видео, вы увидите новое, обновлённое изображение.

Мы связались с Google за разъяснениями по поводу этой проблемы. Мы надеемся, что они смогут провести расследование и предотвратить появление в лентах пользователей некачественного, и особенно неподобающего, контента, сгенерированного искусственным интеллектом.

Смотрите также

- Лучшие телефоны Android для студентов 2024 года

- Я протестировал три разных дисплея, удобных для глаз, так что вам не придется

- Новый превью ‘Avatar: Fire and Ash’ опубликован перед показом во время Monday Night Football.

- Готовы к удивительной классике научной фантастики? Поклонники выбрали 10 лучших научно-фантастических фильмов всех времен, и список просто эпичен!

- Лучшие защитные пленки для экрана Motorola Razr 2024 2024 года

- Лучшие телефоны для людей, чувствительных к ШИМ/мерцанию, 2024 г.

- Поддерживает ли Samsung Galaxy S24 FE eSIM и две SIM-карты?

- 10 лучших чехлов, которые обязательно нужно иметь для вашего нового Samsung Galaxy S25 Ultra!

- ANBERNIC только что опубликовал видео о RG VITA Pro, и это зверь с двойной ОС.

- Актер «Школы разбитого сердца» присоединился к актерскому составу «Крика 7»

2025-10-27 16:18