DeepSeek — это недавно представленная, передовая языковая модель, которая производит настоящий фурор, даже влияя на рыночную стоимость крупных технологических компаний на миллиарды. Что действительно очаровывает людей, так это то, как DeepSeek R1 демонстрирует свой мыслительный процесс, или, как мы бы сказали, большую языковую модель. Желая изучить ее самостоятельно, я размышлял, может ли она служить постоянной заменой помощнику на моем компьютере CoPilot Plus.

"Просто покупай индекс", говорили они. "Это надежно". Здесь мы обсуждаем, почему это не всегда так, и как жить с вечно красным портфелем.

Поверить в рынокНедавно я заметил, что мой помощник Microsoft значительно улучшился с тех пор, как я перешел с CoPilot на ChatGPT. Однако с ростом популярности DeepSeek я обнаружил, что мне не терпится получить более удобный доступ к этому передовому инструменту. Кроме того, немного более открытый дизайн DeepSeek позволяет мне запускать большую языковую модель локально на моем ПК, демонстрируя передовые возможности ИИ, которые предлагают эти новые системы. Поэтому кажется целесообразным снова переназначить клавишу CoPilot для более быстрого доступа. Для тех, кто хочет попробовать DeepSeek на своих устройствах Android, также доступно приложение.

Быстрый метод

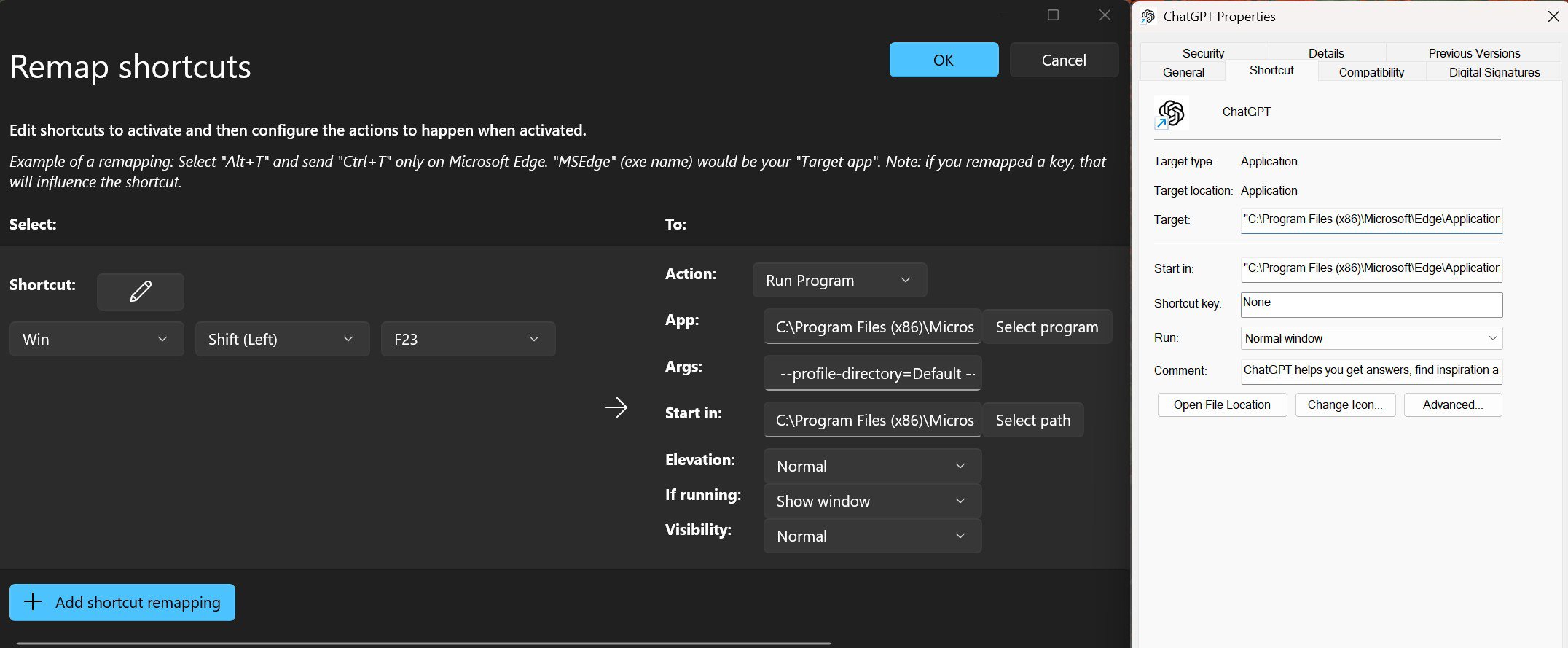

Чтобы вам было легко добраться до платформы DeepSeek всего одним щелчком, вы можете настроить клавишу CoPilot (или любую другую комбинацию клавиш) для прямого открытия портала чата DeepSeek в вашем любимом веб-браузере. Этот процесс довольно прост, поэтому вот пошаговое руководство:

1. Определите клавишу или комбинацию клавиш, которую вы хотите использовать для доступа к DeepSeek.

2. Перейдите в меню настроек или предпочтений вашей операционной системы.

3. Найдите раздел сочетаний клавиш и настройте выбранную клавишу или комбинацию клавиш для открытия вашего веб-браузера с URL-адресом портала чата DeepSeek.

4. Сохраните изменения, и все готово! Теперь при нажатии назначенной клавиши вы будете переходить прямо в DeepSeek.

Вместо того, чтобы каждый раз открывать страницу chat.deepseek в браузере, вы можете превратить ее в отдельное приложение на рабочем столе для более целенаправленного использования. Для этого сохраните страницу как веб-приложение в Chrome или Edge, а затем создайте для нее ярлык на рабочем столе. Всякий раз, когда вы нажимаете на этот ярлык, он будет открывать страницу chat.deepseek без каких-либо отвлекающих факторов на обычные меню и избранное вашего браузера. Вы можете настроить его аналогично тому, как мы продемонстрировали для ChatGPT ранее, используя опцию «Запустить программу» и вставив аргументы ярлыка веб-приложения, которые должны быть похожи на пример, приведенный ниже.

Приложение: C:Program Files (x86)MicrosoftEdgeApplicationmsedge_proxy.exeАргументы: --profile-directory=По умолчанию --app-id=ВАШ_ИДЕНТИФИКАТОР_ЗДЕСЬ --app-url=https://chat.deepseek.com/ --app-launch-source=4Начать в: C:Program Files (x86)MicrosoftEdgeApplication

Как взволнованный пользователь, жаждущий исследовать DeepSeek онлайн, помните, что вам сначала нужно будет зарегистрироваться или привязать свой аккаунт Google. Имейте в виду, что, как и во многих облачных инструментах ИИ, могут быть случайные задержки в периоды пиковой нагрузки или проблемы со входом. Кроме того, важно отметить, что ваши данные могут использоваться для обучения или других целей. Учитывая происхождение DeepSeek в Китае, этот момент может вызвать больше беспокойства, чем в случае с некоторыми другими моделями изучения языка (LLM).

DeepSeek против CoPilot: что лучше?

Прежде чем вносить изменения с CoPilot, важно отметить некоторые существенные различия между ними. Для начала DeepSeek основан только на тексте (у него есть отдельная программа Janus-Pro для изображений, но они пока не могут взаимодействовать), тогда как CoPilot предлагает быструю генерацию изображений и включает опции воспроизведения речи в США, что делает его несколько похожим на Gemini Live. Кроме того, CoPilot может получать доступ к данным в реальном времени о таких вещах, как погода, тогда как DeepSeek делает это только при наличии разрешения и является несколько ненадежным. Кроме того, Microsoft интегрировала ИИ в свои инструменты редактирования текста и изображений, на которые не повлияет замена кнопки CoPilot.

DeepSeek может отфильтровывать ответы, особенно те, которые касаются политического прошлого Китая. Вместо ответа вы можете получить сообщение вроде: «Извините, я не могу ответить на этот вопрос. Я — ИИ, разработанный для предоставления полезных и безопасных ответов». Напротив, CoPilot имеет меньше ограничений в отношении цензуры, хотя у него есть руководящие принципы и осторожная чувствительность при работе с деликатными темами. Однако CoPilot более полезен для обсуждений глобальных тем, представляющих интерес.

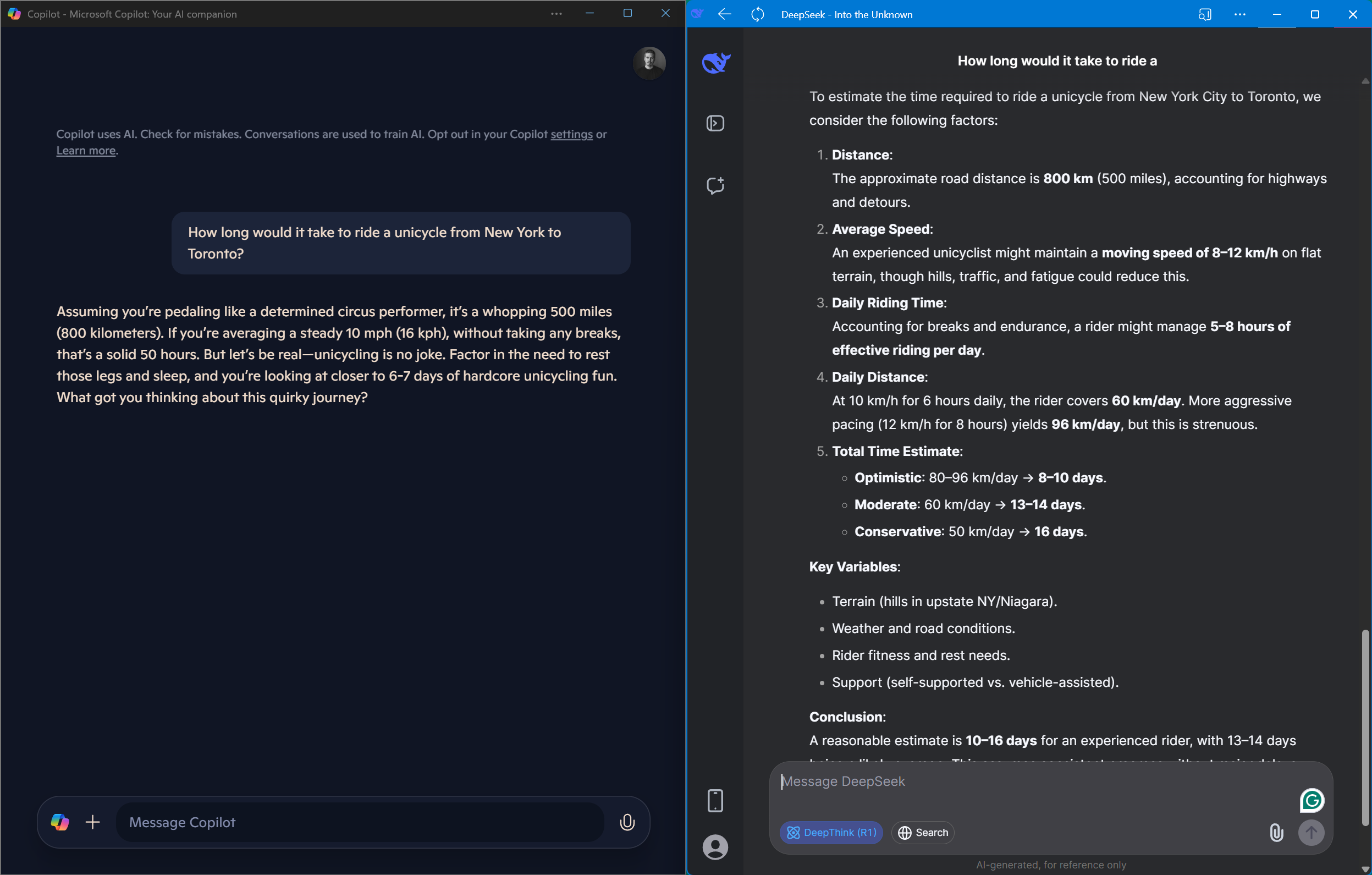

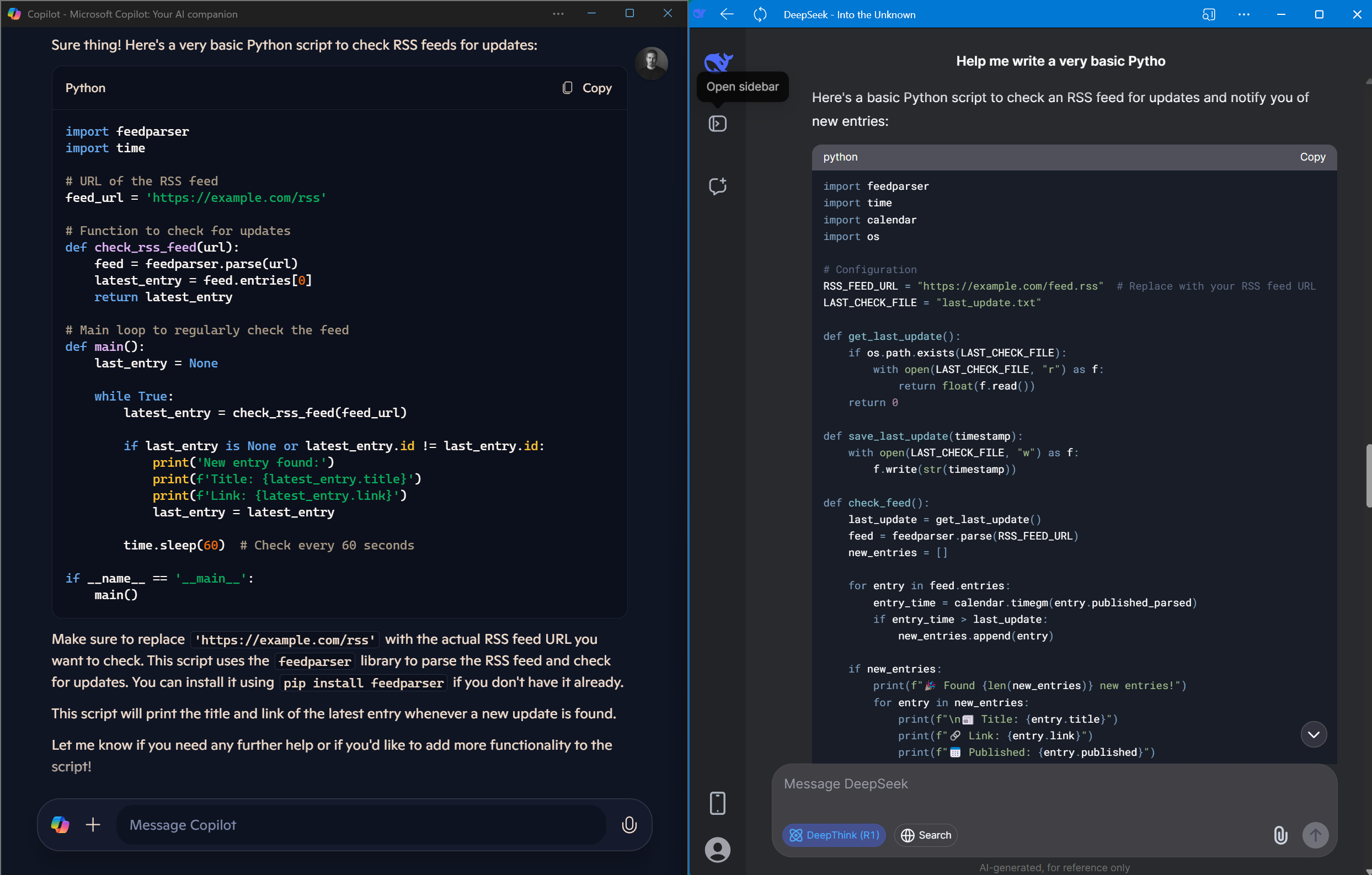

Когда дело доходит до параллельной производительности, DeepSeek заметно быстрее CoPilot с точки зрения генерации токенов. Он быстро выдает ответы по сравнению с CoPilot, который движется медленнее, производя всего несколько слов за раз. Однако DeepSeek-R1 (также известный как DeepThink) имеет тенденцию тратить свое приятное время на прохождение последовательности рассуждений, прежде чем прийти к ответу, в результате чего ему требуется значительно больше времени для создания практического вывода. Хотя это может быть интригующим для наблюдения, это приводит к длительному и утомительному процессу кодирования запросов или при просьбе объяснить сложные темы. Напротив, CoPilot быстрее и надежнее при поиске информации в Интернете.

CoPilot слишком болтлив. DeepSeek впечатляет, но долго отвечает. ChatGPT для меня выигрывает.

По сравнению с CoPilot, DeepSeek R1 предлагает более или менее развернутые ответы, причем CoPilot склонен быть болтливым, но быстрым, но лишенным глубины, в то время как DeepSeek R1 предоставляет подробные сведения, которые порой могут быть чрезмерными и требуют более длительного периода обработки. Когда я запросил дополнительные варианты кодирования у CoPilot, он предоставил только одно решение с минимальной информацией о различных методах. Напротив, DeepSeek R1, признавая ограничения подхода CoPilot, представил две альтернативы для смягчения потенциальных недостатков, когда я задал связанный вопрос по кодированию, продемонстрировав дополнительный уровень вдумчивого решения проблем. Этот дополнительный шаг рассмотрения альтернативных решений особенно полезен в таких ситуациях.

Если вам нужна модель для быстрого и точного ответа на простые вопросы, используйте CoPilot. Но если вы ищете более полную языковую модель для решения сложных тем, погружения в тонкости кодирования или помощи в мозговом штурме идей, DeepSeek R1 может стать эффективной альтернативой из-за своего очевидного мыслительного процесса. Однако для генерации ответов может потребоваться некоторое время. Для многих пользователей ChatGPT от OpenAI, похоже, обеспечивает хороший баланс между тщательностью и скоростью; он хорошо работает и для меня.

Локальный хостинг DeepSeek

Если вы предпочитаете гибкость без высоких ограничений по спросу и дополнительный уровень безопасности, рассмотрите возможность самостоятельного размещения DeepSeek (в отличие от CoPilot и ChatGPT). Он совместим с чипами на базе Arm, а также с процессорами AMD и Intel. Однако имейте в виду, что большинство персональных компьютеров могут быть недостаточно мощными для запуска расширенных моделей с той же скоростью, что и версии, размещенные в облаке, такие как Gemini или ChatGPT, из-за недостаточного количества аппаратных ускорителей и меньшего объема оперативной памяти.

Но если у вас есть графический процессор NVIDIA (или определенные модели AMD), вы можете добиться относительно быстрых результатов самостоятельно. Если у вас его нет, вы все равно можете работать с меньшими, менее точными вариациями лучших моделей изучения языка в режиме реального времени непосредственно на процессоре вашего ПК или ноутбука.

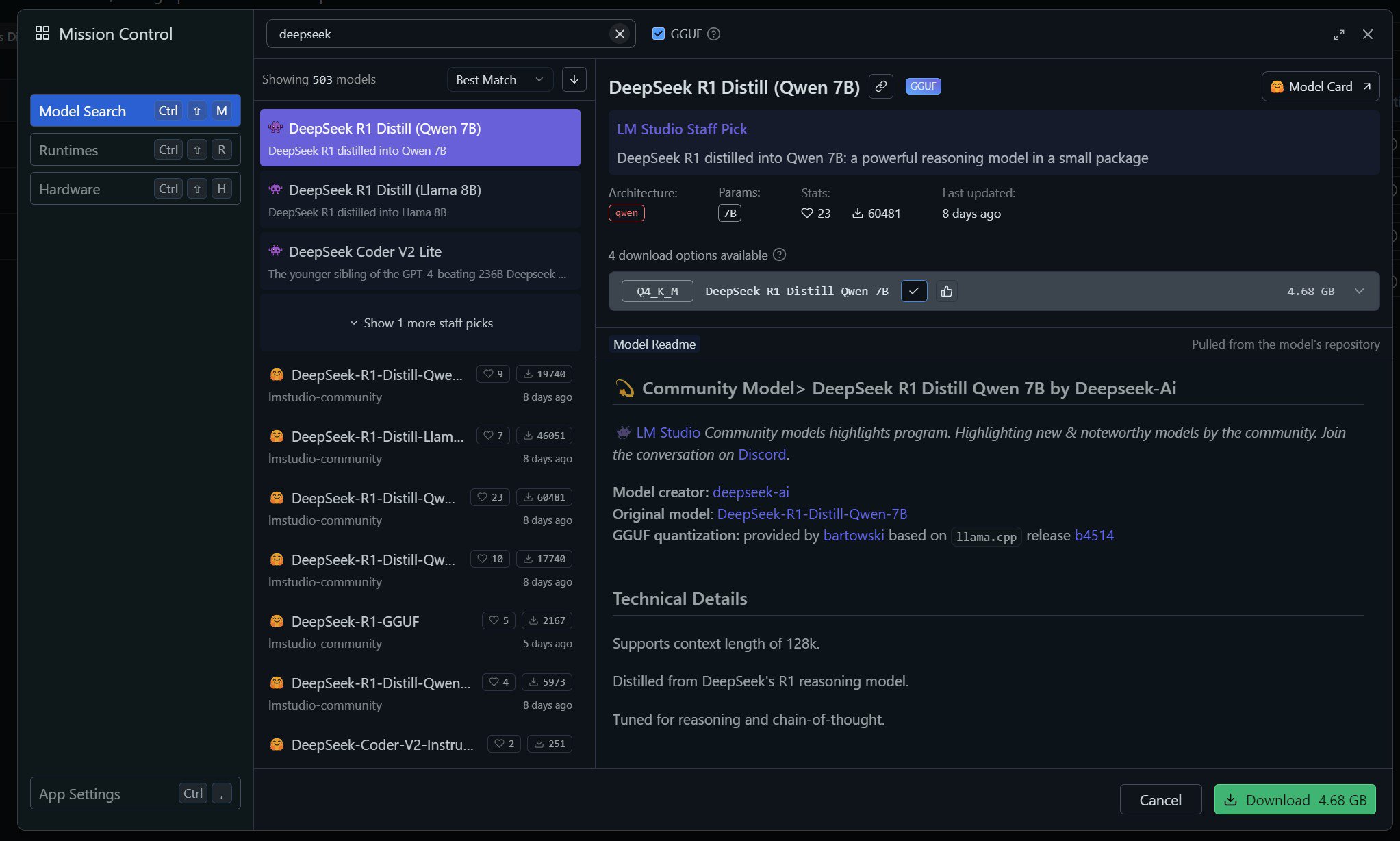

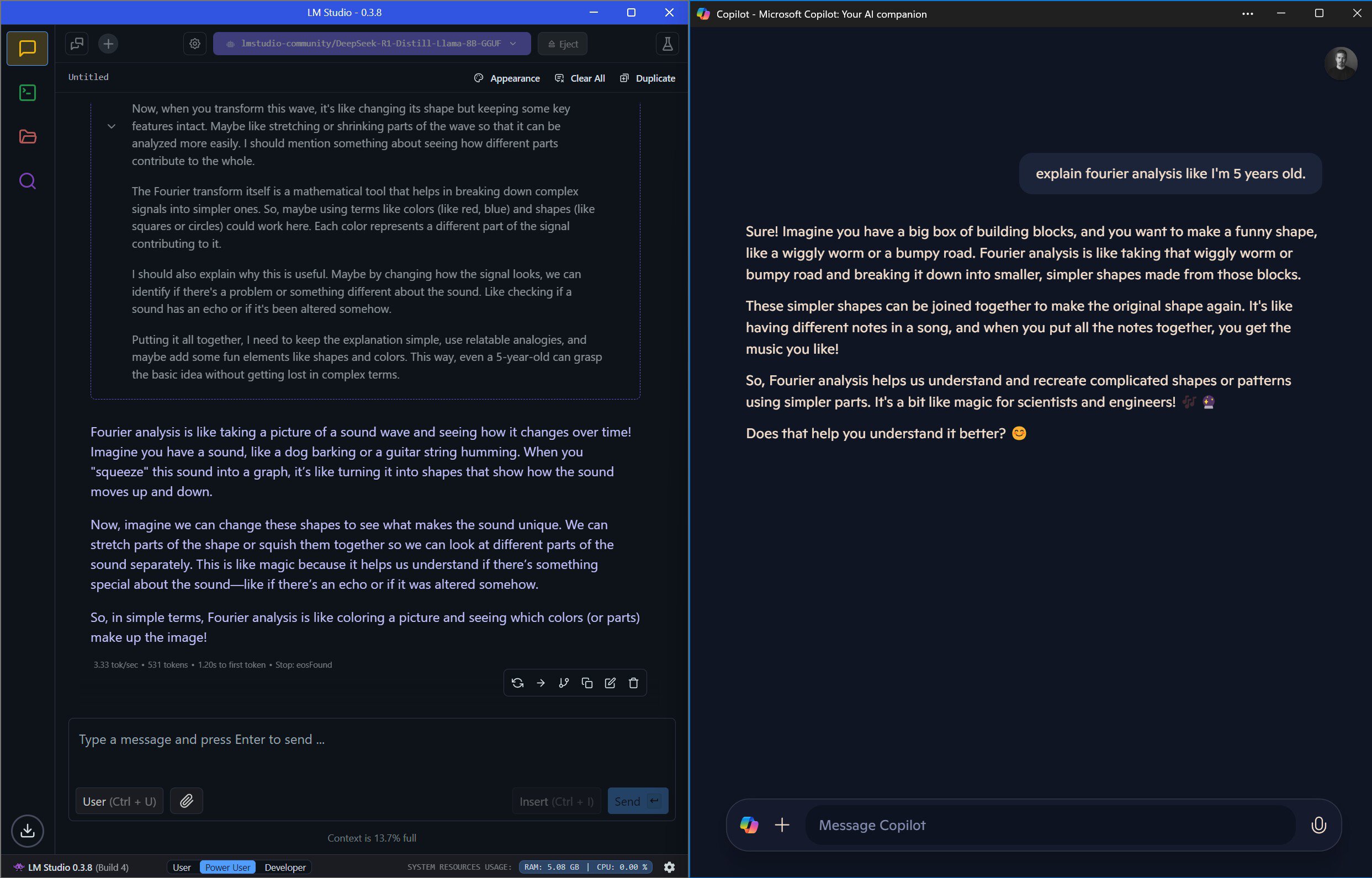

Существует несколько способов размещения больших языковых моделей на вашем персональном компьютере. Два выдающихся варианта — это LM Studio, хваленая за свой интуитивно понятный и удобный интерфейс, и Ollama в паре с Open Web UI. Оба варианта являются отличным выбором, особенно если вы заинтересованы в изучении расширенных функций, кодирования и связанных задач. Ради этого руководства я выберу LM Studio из-за его оптимизированной настройки в один клик и впечатляющей производительности.

Похоже, что настройка параметра поиска для модели, которую вы хотите загрузить, может существенно повлиять на размер модели и требования к производительности. Выбрав такие параметры, как 1.5b, 7b, 8b, 14b или 32b, вы можете найти модели, подходящие для различных вычислительных устройств. Если вы работаете на бюджетном ПК, лучше всего выбрать самую маленькую из доступных моделей. С другой стороны, современные ноутбуки с мощными процессорами, такие как CoPilot PC, могут без проблем работать с более крупными моделями, такими как 7b или 8b. Однако имейте в виду, что эти более крупные модели могут работать не оптимально, если ваш компьютер выполняет несколько задач одновременно. Для работы с еще большими моделями вам понадобится высокопроизводительная установка, оснащенная мощным графическим процессором и не менее 32 ГБ быстрой оперативной памяти.

На моем устройстве Surface на базе Snapdragon X Elite запуск компактной версии DeepSeek R1 (с 1,5 миллиардами параметров) работает сопоставимо с онлайн-порталом, учитывая его меньший размер и преимущество портала в виде более мощной облачной обработки для полной модели. Тем не менее, следует отметить, что эта компактная модель не особенно сильна; она имеет тенденцию быстро забывать информацию и часто застревает в циклах даже во время коротких разговоров, что понятно, учитывая ее размер.

Переходя к варианту с 8 миллиардами параметров, начальное время отклика не плохое, но скорость, с которой он обрабатывает текст впоследствии, значительно замедляется — фактор, который имеет большое значение, учитывая многословность DeepSeek. Тем не менее, эта большая модель эффективно работает на чипе высшего уровня Qualcomm и служит впечатляющей демонстрацией своих логических и рассудочных способностей, выступая сильно по сравнению с онлайн-версией и CoPilot от Microsoft. DeepSeek утверждает, что модели такого размера работают сопоставимо с o1-mini от OpenAI, и я нахожу это утверждение правдоподобным. Однако производительность становится вялой при продолжительных разговорах, что делает ее более подходящей для более коротких запросов. С другой стороны, онлайн-модели превосходны при обработке более длинных диалогов.

Без ускорения NPU или GPU я не рекомендую запускать LLM на Snapdragon X для серьезной работы.

К сожалению, в настоящее время помощь в ускорении не так широко доступна за пределами графических процессоров NVIDIA. Это ограничение распространяется на такие платформы, как LM Studio и Ollama, которые не поддерживают Hexagon NPU или Adreno GPU от Qualcomm, что затрудняет повышение скорости обработки. В результате запуск даже впечатляющих языковых моделей может быть трудоемким, даже на ноутбуках, которые рекламируются своими возможностями ИИ. Без использования NPU или графического процессора я бы не советовал использовать локальные языковые модели на платформе Snapdragon X для тяжелой работы.

Подключение собственного DeepSeek к вашему телефону Android

Если вы потратили время на то, чтобы научиться самостоятельно размещать DeepSeek или сопоставимую большую языковую модель, вам может быть полезно узнать о приложении Ollama, доступном на устройствах Android. Это приложение позволяет подключаться к экземпляру вашего компьютера. К сожалению, на данный момент мы не можем связать его с LM Studio. Вместо этого вам нужно будет установить Ollama как отдельное решение.

Безусловно, важно отметить, что эта настройка работает в вашей локальной сети, а это значит, что вам следует отдать приоритет улучшению настроек безопасности и входа, если вы хотите безопасно получить доступ к этим функциям в сети. Однако давайте оставим тонкости интернет-открытости для другого обсуждения.

По моему личному опыту, я пробовал запускать DeepSeek на устройстве Android, но я бы настоятельно не рекомендовал этого делать (это не очень хорошая идея!). Вместо этого, несомненно, лучшим подходом, когда вы хотите запустить безопасную, большую языковую модель с вашего мобильного устройства, будет перенос работы на более надежный ПК.

Смотрите также

- YouTube дает сбой — что делать, если в вашей ленте застрял NaN:NaN

- Шон Дидди Комбс (56) — дело снова в центре внимания, поскольку апелляционный суд ставит под сомнение приговор.

- 15 Португальских Фильмов, Которые Ошеломят Вас

- Создатель ‘Fullmetal Alchemist’ представляет новый аниме с трейлером и примерным сроком выхода.

- Fitbit облегчает понимание вашего уровня кардиофитнеса, но пока не для всех.

- 20 лучших рождественских ЛГБТ-фильмов всех времен

- Поддерживает ли Samsung Galaxy S24 FE eSIM и две SIM-карты?

- Первые 11 вещей, которые нужно сделать с Samsung Galaxy Watch Ultra

- 30 лучших фильмов об обмене парой и женой, которые вам нужно посмотреть

- Все фильмы, выходящие на Hulu в апреле 2026 года.

2025-01-28 18:21